Magika de código aberto do Google: ferramenta de identificação de arquivos com tecnologia de IA

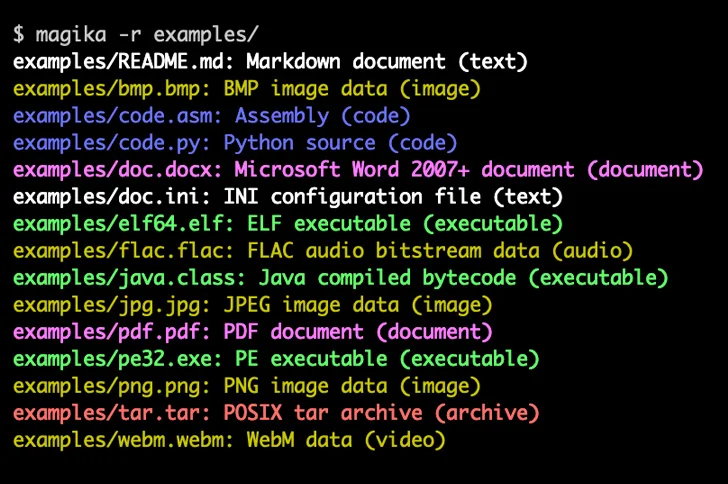

O Google anunciou que está abrindo o código-fonte do Magika, uma instrumento alimentada por lucidez sintético (IA) para identificar tipos de arquivos, para ajudar os defensores a detectar com precisão tipos de arquivos binários e textuais.

“Magika supera os métodos convencionais de identificação de arquivos, fornecendo um aumento universal de 30% na precisão e até 95% maior precisão em conteúdos tradicionalmente difíceis de identificar, mas potencialmente problemáticos, porquê VBA, JavaScript e Powershell”, disse a empresa.

O software usa um “protótipo de aprendizagem profundo personalizado e altamente otimizado” que permite a identificação precisa de tipos de arquivos em milissegundos. Magika implementa funções de inferência usando Open Neural Network Exchange (ONNX).

O Google disse que usa Magika internamente em grande graduação para ajudar a melhorar a segurança dos usuários, roteando arquivos do Gmail, Drive e Navegação segura para os scanners adequados de segurança e política de teor.

Em novembro de 2023, a gigante da tecnologia lançou o RETVec (abreviatura de Resilient and Efficient Text Vectorizer), um protótipo de processamento de texto multilíngue para detectar teor potencialmente prejudicial, porquê spam e e-mails maliciosos no Gmail.

Em meio a um debate contínuo sobre os riscos da tecnologia em rápido desenvolvimento e seu insulto por segmento de atores estatais associados à Rússia, China, Irã e Coreia do Setentrião para impulsionar seus esforços de hacking, o Google disse que a implantação de IA em graduação pode fortalecer a segurança do dedo e “inclinar o estabilidade da segurança cibernética, dos atacantes aos defensores.”

Enfatizou também a premência de uma abordagem regulamentar equilibrada à utilização e adoção da IA, a término de evitar um horizonte em que os atacantes possam inovar, mas os defensores sejam restringidos devido às escolhas de governação da IA.

“A IA permite que profissionais de segurança e defensores escalem seu trabalho na detecção de ameaças, estudo de malware, detecção de vulnerabilidades, correção de vulnerabilidades e resposta a incidentes”, observaram Phil Venables e Royal Hansen da gigante da tecnologia. “A IA oferece a melhor oportunidade para derrubar o Dilema do Protector e inclinar a balança do ciberespaço para dar aos defensores uma vantagem decisiva sobre os atacantes.”

Também foram levantadas preocupações sobre o uso de dados extraídos da web por modelos de IA generativos para fins de treinamento, que também podem incluir dados pessoais.

“Se você não sabe para que o seu protótipo será usado, porquê pode prometer que seu uso ulterior respeitará a proteção de dados e os direitos e liberdades das pessoas?”, apontou o Gabinete do Comissário de Informação do Reino Uno (ICO) no mês pretérito.

Além do mais, uma novidade pesquisa mostrou que grandes modelos de linguagem podem funcionar porquê “agentes adormecidos” que podem ser aparentemente inócuos, mas podem ser programados para se envolverem em comportamentos enganosos ou maliciosos quando critérios específicos são atendidos ou instruções especiais são fornecidas.

“Esse comportamento backdoor pode se tornar persistente para que não seja removido por técnicas padrão de treinamento de segurança, incluindo ajuste fino supervisionado, aprendizagem por reforço e treinamento contendedor (provocar comportamento inseguro e depois treinar para removê-lo), disseram pesquisadores da startup de IA Anthropic. no estudo.